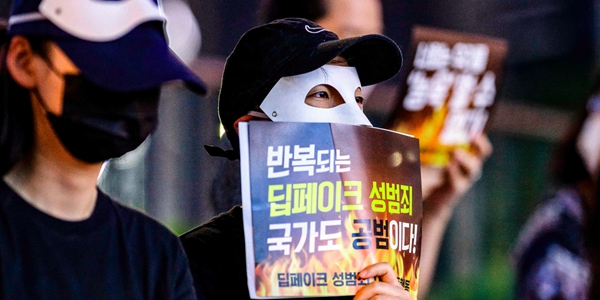

▲ 8월30일 서울 강남역에서 활동가들이 딥페이크 포르노 관련 정부 방침을 비판하는 시위를 벌이고 있다. <연합뉴스>

5일(현지시각) 기술 전문매체 테크크런치에 따르면 마이크로소프트는 이미지 해싱 관련 기술 플랫폼인 ‘스톱NCII(non-consensual intimate images, 동의하지 않은 개인적 이미지를 멈춰라)’와 협업을 발표했다.

스톱NCII는 국제 자선 단체인 SWGfL 아래 ‘리벤지 포르노 헬프라인’에서 운영한다. 이미지 해싱은 알고리즘을 사용해서 이미지에 고유한 해시값을 할당하는 기술이다. 디지털 지문이라고 불리기도 한다.

이를 활용하면 자신의 동의 없이 온라인에서 사적인 이미지가 공유되는 것을 막을 수 있다.

사용자가 스톱NCII로 이미지를 찾아 마이크로소프트와 같은 기업에 신고하면 해당 기업이 정책에 따라 이미지를 삭제하거나 하는 방식이다.

마이크로소프트는 이미 올해 3월부터 8월까지 스톱NCII 기술을 시범적으로 도입해 26만8899개의 이미지에 조치를 취했다.

마이크로소프트는 공식 블로그를 통해 “자체 이미지 검색 도구를 제공해 봤지만 불충분했다”라며 스톱NCII와 협업 이유를 설명했다.

테크크런치는 마이크로소프트의 이런 움직임 배경으로 인공지능(AI) 딥페이크로 만든 포르노 영상으로 피해가 확산되고 있다는 점을 지목했다. 미국 연방법은 인공지능 딥페이크 포르노 관련 규정이 부재한 것으로 전해졌다.

2020년 이후 현재까지 17만 여 개의 유튜브 성적 콘텐츠가 신고된 한국 사례도 거론됐다.

다만 테크크런치는 스톱NCII가 18세 이상 성인만을 대상으로 제공하고 미성년자는 활용할 수 없다는 점도 함께 짚었다.

스톱NCII에 따르면 리벤지 포르노 헬프라인은 2015년 설립 이후 90% 이상 삭제율로 20만 개 이상의 온라인 이미지를 처리했다. 지원한 피해자도 수천 명에 달한다.

이지연 한국외국어대학교 상담심리학과 부교수도 외부 전문가 자격으로 스톱NCII 홈페이지에 이름을 올리고 있다. 이근호 기자

![[여론조사꽃] 이재명 지지율 73.6%로 2.9%p 내려, 민주당 55.9% vs 국힘 24.5%](https://businesspost.co.kr/news/photo/202605/20260511111534_53025.jpg)